Generative Suchsysteme wie AI Overviews, ChatGPT Search, Perplexity oder Copilot greifen nicht einfach auf eine einzelne Webseite zu und übernehmen deren Text. Sie crawlen, indexieren, vergleichen, zerlegen und kombinieren Informationen aus unterschiedlichen Quellen. Für Unternehmen verändert das die Anforderungen an digitale Sichtbarkeit. Es geht nicht mehr allein darum, Inhalte zu veröffentlichen. Inhalte müssen so organisiert sein, dass sie in verschiedenen Such- und Antwortsystemen als verlässliche Wissensbausteine funktionieren.

Die zentrale Frage lautet deshalb: Ist unser Wissen technisch zugänglich, eindeutig strukturiert, konsistent gepflegt und als Quelle vertrauenswürdig genug?

Contents

- GEO ist der Aufhänger, SEO bleibt die Grundlage

- Warum GEO technische Architektur braucht

- Human UI vs. Agent Interface

- CMS vs. Headless: Die eigentliche Entscheidung

- Die Architektur für GEO

- Minimum Viable Setup vs. Enterprise Setup

- Typische Schwachstellen in der Praxis

- Was Unternehmen jetzt priorisieren sollten

- Fazit: GEO belohnt verwendbares Wissen

GEO ist der Aufhänger, SEO bleibt die Grundlage

GEO steht für Generative Engine Optimization. Gemeint ist die Optimierung von Inhalten, Daten und digitalen Signalen für generative Such- und Antwortsysteme.

SEO verschwindet dadurch nicht. Crawling, Rendering, Indexierung, interne Verlinkung, technische Qualität und Autorität bleiben die Grundlage. Wer in generativen Formaten erscheinen will, braucht weiterhin Inhalte, die für Suchmaschinen zugänglich und indexierbar sind.

Der Unterschied liegt in der Nutzung: Klassische Suchergebnisse verweisen stärker auf einzelne Seiten. Generative Systeme bauen Antworten aus mehreren Informationsbausteinen. Dafür müssen Inhalte klarer, konsistenter und maschinell besser interpretierbar sein.

AEO ergänzt diesen Blick um direkte Antwortfähigkeit: Definitionen, präzise Aussagen, klare Fragen und Antworten. Agentische Suche geht noch einen Schritt weiter und braucht zusätzlich entscheidungsfähige Daten.

Die saubere Arbeitslogik lautet: SEO schafft Zugänglichkeit. AEO schafft Antwortfähigkeit. GEO schafft Verwendbarkeit in generativen Systemen. Agentische Suche verlangt zusätzlich entscheidungsfähige Daten.

Warum GEO technische Architektur braucht

Viele Unternehmen behandeln Content noch immer wie eine Sammlung einzelner Seiten: eine Serviceseite hier, ein Blogartikel dort, Produktdaten im PIM, Standortdaten in einer Excel-Datei, Autor:innenprofile im HR-System, Bewertungen auf externen Plattformen. Für Menschen kann dieses System gerade noch funktionieren. Für generative Suchsysteme entsteht schnell Unschärfe.

Ein Beispiel: Ein Unternehmen nennt dieselbe Leistung auf der Website „Customer Analytics“, im Vertrieb „CRM Intelligence“, in PR-Artikeln „AI Sales Insights“ und in Produktdaten „Analytics Platform“. Ohne klare Entitätslogik ist schwer erkennbar, ob es sich um ein Produkt, eine Kategorie, eine Funktion oder eine Beratungsleistung handelt.

GEO braucht deshalb eine Architektur, die Bedeutung stabilisiert. Die Website bleibt wichtig, ist aber nur die sichtbare Ausgabeschicht. Dahinter braucht es eine verlässliche Struktur für Inhalte, Fakten, Entitäten, Beziehungen und Ausspielung.

Human UI vs. Agent Interface

Eine Website hat heute zwei sehr unterschiedliche Zielgruppen.

Die erste Zielgruppe sind Menschen. Sie brauchen Orientierung, Verständlichkeit, Vertrauen, Design, Performance und einen klaren Weg zur nächsten Handlung.

Die zweite Zielgruppe sind Maschinen: Suchmaschinen, AI-Crawler, Antwortsysteme, interne Suchsysteme, Produktfeeds, Partnerplattformen und künftig stärker auch agentische Systeme. Sie brauchen keine schöne Oberfläche. Sie brauchen Zugriff, Struktur, Eindeutigkeit und konsistente Daten.

Das ist der Unterschied zwischen Human UI und Agent Interface. Die Human UI ist die sichtbare Website. Das Agent Interface ist die maschinelle Zugriffsebene: strukturierte Daten, Feeds, APIs, Entitäten, IDs, Metadaten, Crawling-Regeln und Wissensmodelle.

Viele Unternehmen optimieren fast ausschließlich die Human UI. Das reicht für GEO nicht. Generative Sichtbarkeit entsteht dort, wo Inhalte für Menschen verständlich und für Systeme sauber verwertbar sind.

CMS vs. Headless: Die eigentliche Entscheidung

Die Diskussion „klassisches CMS oder Headless“ greift zu kurz. Die wichtigere Frage lautet: Wo liegt die verlässliche Quelle für Inhalte, Fakten und Entitäten?

Ein klassisches CMS kann völlig ausreichen, wenn ein Unternehmen wenige Seitentypen, überschaubare Workflows und ein kleines Content-Team hat. Schwieriger wird es, wenn Inhalte über mehrere Märkte, Marken, Sprachen, Plattformen oder Datenquellen hinweg konsistent bleiben müssen. Dann zeigt sich die Schwäche vieler klassischer Setups: Content wird seitenzentriert gepflegt, Fakten werden mehrfach eingetragen, Entitäten bleiben implizit.

Headless- und Composable-Ansätze können diese Probleme besser lösen, wenn sie sauber umgesetzt werden. Sie trennen Inhaltsverwaltung und Ausspielung. Inhalte, Daten und Komponenten lassen sich zentral modellieren und über APIs an Websites, Apps, Feeds oder interne Systeme ausgeben.

Aber Headless ist kein automatischer GEO-Vorteil. Wenn wichtige Inhalte erst clientseitig nachgeladen werden, Canonicals fehlen, hreflang nicht sauber ausgespielt wird oder strukturierte Daten nicht im gerenderten Output landen, entsteht ein Sichtbarkeitsproblem.

Die Regel ist einfach: Die beste Architektur ist meist die, bei der wichtige Inhalte, Signale und Beziehungen zuverlässig im finalen Output ankommen.

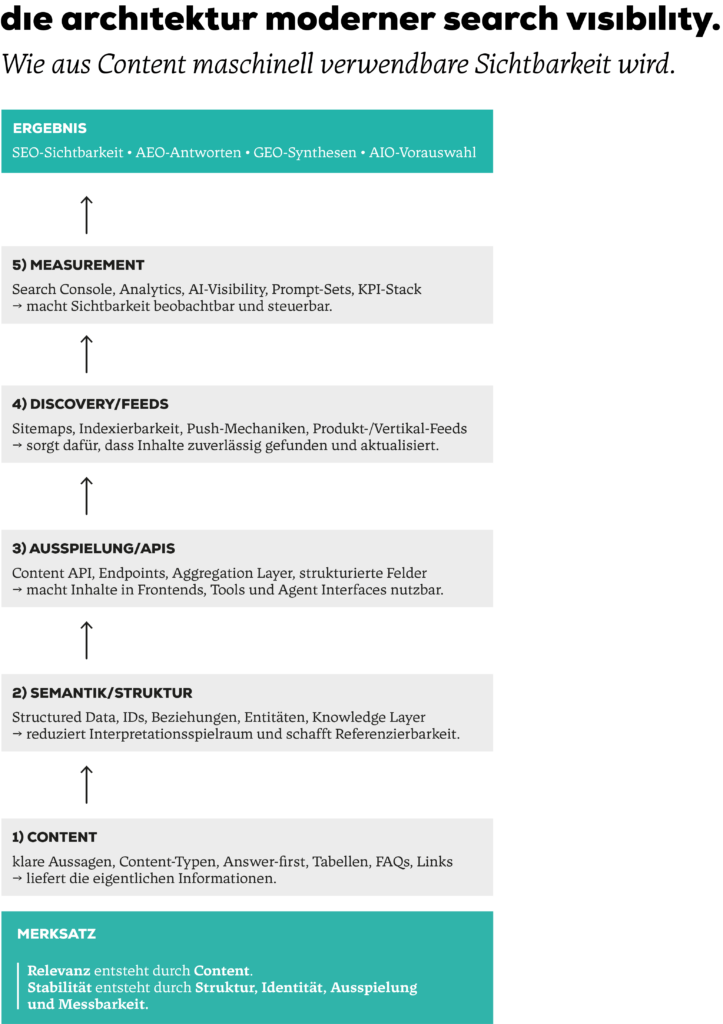

Die Architektur für GEO

GEO wird greifbar, wenn man die Architektur in Schichten denkt. Jede Schicht erfüllt eine eigene Aufgabe. Wenn eine davon schwach ist, verliert das Gesamtsystem an Verlässlichkeit.

1. Access- und Content-Layer: Sind Inhalte erreichbar und als Bausteine aufgebaut?

Bevor Inhalte in generativen Antworten auftauchen können, müssen sie im sogenannten Access-Layer technisch erreichbar sein. Dazu gehören Crawling, Rendering, Indexierung, Statuscodes, robots.txt, interne Verlinkung, XML-Sitemaps, Canonicals, hreflang und Performance. Gerade bei Relaunches, Headless-Migrationen und JavaScript-lastigen Frontends entstehen hier viele Probleme. Inhalte sind für Nutzer sichtbar, aber für Crawler verzögert, unvollständig oder inkonsistent erreichbar.

Gleichzeitig reicht Erreichbarkeit allein nicht aus. Inhalte müssen auch so aufgebaut sein, dass sie als Wissensbausteine funktionieren. Generative Systeme arbeiten mit Aussagen, Definitionen, Kriterien, Produktattributen, Vergleichen, Beispielen und Beziehungen. Deshalb sollten Inhalte stärker gegliedert sein: etwa in Leistungsdefinition, Zielgruppe, Einsatzszenarien, Abgrenzung zu verwandten Leistungen, Belege, Cases, häufige Fragen und Entscheidungskriterien. Das macht Inhalte für Menschen besser lesbar und für Systeme leichter interpretierbar.

Die Management-Frage lautet: Können Suchsysteme unsere wichtigsten Inhalte zuverlässig abrufen und sinnvoll einordnen?

2. Entity-, Knowledge- und Schema-Layer: Ist klar, worüber gesprochen wird?

Hier liegt der Kern moderner GEO-Architektur.

Entitäten sind die zentralen Dinge, über die ein Unternehmen spricht: Marke, Produkt, Service, Standort, Person, Branche, Technologie, Thema oder Use Case. Wenn diese Entitäten uneinheitlich benannt, unklar abgegrenzt oder verstreut gepflegt werden, verlieren Inhalte an maschineller Eindeutigkeit.

Ein Knowledge Layer stabilisiert diese Bedeutung. Er definiert, welche Entitäten existieren, wie sie heißen, welche Attribute sie haben und wie sie miteinander verbunden sind. Für kleinere Unternehmen muss das kein komplexer Knowledge Graph sein. Oft reicht ein sauberes Contentmodell mit stabilen Ankerseiten und konsistenter Begriffsnutzung. Für größere Organisationen wird daraus ein echtes Wissensmodell mit Entitäts-IDs, Beziehungen, Datenquellen und Governance.

Structured Data übersetzt Teile dieses Wissens in eine maschinenlesbare Form. Es garantiert keine Sichtbarkeit, reduziert aber Interpretationsaufwand, wenn es korrekt, konsistent und mit dem sichtbaren Inhalt abgestimmt ist.

Für viele Unternehmen ist ein sauberer Kern wichtiger als maximale Schema-Abdeckung. Der häufige Fehler liegt in der Umsetzung: Structured Data wird nachträglich an Templates gehängt, statt aus dem Content- und Entity-Modell zu entstehen. Dann beschreibt das Markup nicht das tatsächliche Wissen des Unternehmens, sondern nur die Oberfläche einer Seite.

Die Management-Frage lautet: Haben wir viele Inhalte oder ein konsistentes Wissenssystem?

3. API- und Feed-Layer: Wie wird Wissen kontrolliert ausgespielt und verteilt?

Der API Layer entscheidet, wie Inhalte und Fakten an verschiedene Ausgabekanäle gelangen: Website, Apps, interne Suche, Produktfeeds, Partnerplattformen, Sales-Systeme, Help Center, Chatbots und künftig auch agentische Interfaces. Der Wert von APIs liegt dabei nicht nur darin, dass externe Systeme direkt zugreifen könnten. Wichtiger ist, dass Unternehmen ihr Wissen konsistent ausspielen können. Eine gute Content API liefert keine beliebigen Textblöcke, sondern strukturierte Felder wie Titel, Beschreibung, Entitätstyp, Canonical, Sprache, Aktualisierungsdatum, Autorenschaft, Beziehungen, Attribute, Medien und Quellen.

Feeds ergänzen diese Logik operativ. Dazu gehören XML-Sitemaps, Produktfeeds, Merchant-Feeds, Standortfeeds, Partnerfeeds oder branchenspezifische Datenformate. Sie helfen Systemen, Inhalte zu entdecken, Änderungen zu erkennen und strukturierte Informationen regelmäßig zu verarbeiten.

Gerade in E-Commerce, Local SEO, Jobs, Immobilien, Reisen oder Marktplätzen sind Feeds oft wichtiger als einzelne Seiten. Preise, Verfügbarkeit, Öffnungszeiten, Produktattribute oder Standortdaten müssen aktuell und konsistent sein.

Die Management-Frage lautet hier: Können wir zentrale Inhalte und Fakten kontrolliert über alle relevanten Kanäle ausspielen und aktuell halten?

4. Measurement-Layer: Wie wird GEO sichtbar und steuerbar?

GEO-Messung ist schwieriger als klassische Ranking-Messung. Einzelne Prompt-Tests reichen nicht aus. Sie sind volatil und abhängig von Plattform, Sprache, Region, Zeitpunkt, Nutzerkontext und Formulierung.

Ein belastbarer Measurement Layer kombiniert deshalb mehrere Signale: klassische SEO-Daten, Analytics-Daten, Referral-Traffic aus AI-Systemen, Bot-Logfiles, Citation-Monitoring, definierte Query-Sets und qualitative Prüfungen der Antwortinhalte.

Für Unternehmen heißt das: GEO-Messung darf nicht bei Sichtbarkeits-Screenshots enden. Sie muss technische Zugriffe, Quellenpräsenz, Erwähnungen, Referrals und Antwortqualität zusammenführen.

Die Management-Frage kann lauten: Messen wir generative Sichtbarkeit wirklich oder sammeln wir nur anekdotische Beispiele?

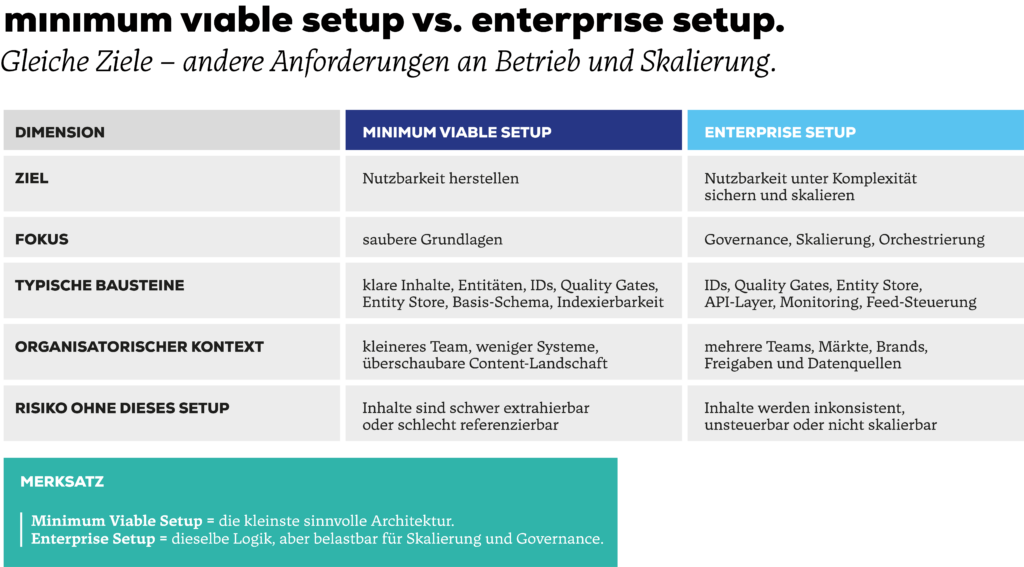

Minimum Viable Setup vs. Enterprise Setup

Nicht jedes Unternehmen braucht dieselbe Ausbaustufe. Ein mittelständisches Unternehmen sollte nicht mit einem komplexen Knowledge-Graph-Projekt starten, wenn Crawling, Content-Struktur und Structured Data noch nicht sauber funktionieren.

Ein Minimum Viable Setup für GEO sollte zuerst die Grundlagen stabilisieren: Die wichtigsten Inhalte müssen crawlbar und indexierbar sein. Zentrale Entitäten brauchen eindeutige Namen, klare Zielseiten und konsistente Beschreibungen. Structured Data sollte für die wichtigsten Seitentypen korrekt ausgespielt werden. Sitemaps, Basis-Feeds, Analytics, Search Console, Bot-Logs und einfache Query-Sets schaffen die erste Steuerbarkeit.

Ein Enterprise Setup braucht mehr: zentrale Entitäts-IDs, Contentmodelle, API-Governance, Feed-Monitoring, Schema-Validierung, Release-QA, Datenverantwortung und einen echten Measurement Stack.

Beide Setups verfolgen dasselbe Ziel: verwendbares Wissen. Der Unterschied liegt in der Betriebsfähigkeit.

Typische Schwachstellen in der Praxis

Die meisten GEO-Probleme entstehen nicht durch fehlenden Content. Sie entstehen durch Brüche zwischen Content, Technik, Daten und Distribution.

Ein Unternehmen kann starke Inhalte haben und trotzdem generativ schlecht sichtbar sein, wenn Entitäten unklar bleiben, strukturierte Daten widersprüchlich sind oder wichtige Fakten in verschiedenen Systemen unterschiedlich gepflegt werden.

Ein anderes Unternehmen kann ein modernes Headless-CMS nutzen und trotzdem Sichtbarkeit verlieren, wenn SEO-Signale nicht sauber im finalen HTML landen.

Oft fehlt auch die externe Bestätigung. Die eigene Website behauptet Kompetenz, aber der Markt bestätigt sie kaum: wenige Erwähnungen, schwache Profile, keine belastbaren Cases, kaum Bewertungen, wenig PR und keine relevanten Drittquellen. Für generative Systeme ist das ein Problem, weil sie Quellen vergleichen und Aussagen einordnen.

Der härteste Punkt ist Governance. Niemand fühlt sich für das gesamte Wissenssystem verantwortlich. Marketing besitzt den Content, IT die Plattform, Data die Quellen, Legal prüft Risiken, SEO findet die Fehler. Diese Trennung funktioniert bei GEO schlecht.

GEO braucht klare Verantwortlichkeiten.

Was Unternehmen jetzt priorisieren sollten

Der erste Schritt ist kein neues Tool. Der erste Schritt ist eine ehrliche Bestandsaufnahme.

Welche Inhalte sind geschäftskritisch? Welche Entitäten müssen eindeutig verstanden werden? Welche Systeme enthalten zentrale Fakten? Wo entstehen Widersprüche? Welche Informationen sind für Crawler erreichbar? Welche Daten werden über Feeds verteilt? Welche AI-Crawler greifen zu? Welche Plattformen erzeugen bereits Referrals oder Erwähnungen?

Danach sollte die Umsetzung in einer klaren Reihenfolge erfolgen: Zuerst Content- und Entity-Klarheit, dann Semantik und technische Ausspielung und anschließend Discovery und Distribution. Erst anschließend lohnt sich anspruchsvolleres GEO-Monitoring. Wer vorher misst, misst oft nur Unordnung.

Fazit: GEO belohnt verwendbares Wissen

GEO ist keine neue Verpackung für klassischen Content. GEO ist die Fähigkeit, Unternehmenswissen so bereitzustellen, dass generative Such- und Antwortsysteme es erkennen, verstehen, einordnen und verwenden können. Dafür braucht es keine überdimensionierte Architektur. Aber es braucht mehr als gute Texte.

Unternehmen müssen ihre Inhalte als Wissenssystem betrachten. Die Website bleibt wichtig, doch sie ist die sichtbare Oberfläche. Darunter liegen Contentmodelle, Entitäten, strukturierte Daten, APIs, Feeds, Bot-Regeln, Measurement und Governance. Die Unternehmen mit der besten Ausgangslage werden nicht zwangsläufig die meisten Inhalte haben. Besser positioniert sind diejenigen, deren Wissen klar strukturiert, glaubwürdig belegt, technisch zugänglich und über relevante Kontexte hinweg sichtbar ist.

GEO belohnt keine Content-Masse. GEO belohnt verwendbares Wissen.

Wir unterstützen Unternehmen dabei, digitale Sichtbarkeit strukturiert weiterzuentwickeln – von SEO-Grundlagen über AEO-/GEO-Konzepte bis zu skalierbaren Content- und Datenprozessen. Im Fokus stehen klare Prioritäten, saubere Umsetzung und messbare Fortschritte über klassische Suche und AI-Search-Oberflächen hinweg.