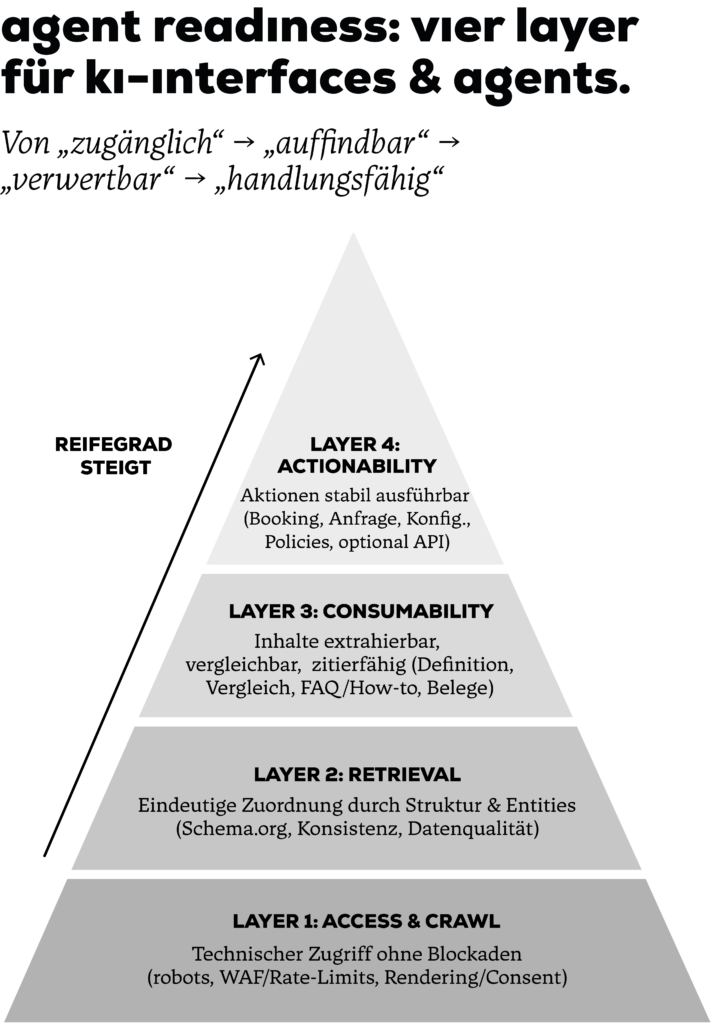

Daraus ergibt sich ein Prüfbedarf, der über ein klassisches SEO‑Audit hinausgeht: Ein Agent Readiness Audit bewertet, ob eine Website technisch zugänglich ist, ob Inhalte zuverlässig wiederauffindbar sind, ob sie gut extrahierbar und zitierfähig aufbereitet sind – und ob sich relevante Aktionen stabil ausführen lassen.

Contents

- Crawlability vs. Retrievability vs. Consumability: Warum „indexierbar“ nicht mehr ausreicht

- Layer 1: Access & Crawl – Wenn Bots keinen stabilen Zugriff haben

- Layer 2: Retrieval – Strukturierte Daten und Entity‑Konsistenz als Anker

- Layer 3: Consumability – Inhalte so gestalten, dass sie extrahierbar, vergleichbar und zitierfähig sind

- Layer 4: Actionability – Wenn KI‑Agents nicht nur lesen, sondern Schritte ausführen

- 30/60/90‑Tage‑Plan: Von Quick Wins zur agentenfähigen Website

- Fazit

Crawlability vs. Retrievability vs. Consumability: Warum „indexierbar“ nicht mehr ausreicht

Klassische Website‑Checks fokussieren häufig auf Crawl‑ und Index‑Grundlagen. Für KI‑Interfaces und agentische Systeme ist das nur die erste Stufe. Praktisch bewährt sich ein Dreiklang:

- Crawlability (technische Erreichbarkeit): Crawlability beschreibt, ob Inhalte technisch erreichbar sind: Zugriff, robots‑Regeln, Statuscodes, interne Verlinkung, Serverantworten sowie Barrieren durch Consent‑Layer oder Security‑Mechanismen.

- Retrievability (präzises Wiederfinden): Retrievability beschreibt, ob Inhalte präzise wiedergefunden und korrekt zugeordnet werden: klare Entitäten (Marke/Organisation/Produkt), konsistente Fakten, strukturierte Daten, gute Informationsarchitektur sowie eine eindeutige Zuordnung von Aussagen zu Seiten und Abschnitten.

- Consumability (Verwertbarkeit in Antwortsystemen): Consumability beschreibt, ob Inhalte so aufbereitet sind, dass sie zuverlässig extrahiert, zitiert und verglichen werden können: klare Definitionen, Vergleichslogik, überprüfbare Aussagen, gut extrahierbare Passagen („snippet‑fähig“) sowie leicht auffindbare Policies und Trust‑Signale. In der Praxis scheitert Sichtbarkeit in KI‑Antworten selten an „zu wenig Content“, sondern häufiger an einer Kombination aus unklarer Struktur, inkonsistenten Fakten und fehlenden, gut extrahierbaren Antwort‑Bausteinen.

Layer 1: Access & Crawl – Wenn Bots keinen stabilen Zugriff haben

Der erste Layer wirkt naheliegend, ist in der Umsetzung jedoch häufig der größte Hebel. Viele Websites sind für menschliche Nutzer zugänglich, aber für maschinelle Systeme nur eingeschränkt erreichbar. Typische Ursachen sind restriktive robots.txt-Regeln, blockierte Ressourcen, aggressive Bot‑Protection, Rate‑Limiting oder Rendering‑Probleme.

Robots, Zugriff und Bot‑Management

Robots‑Konfigurationen (robots.txt und Robots-Meta-Tags) sind oft historisch gewachsen. Im Kontext von KI‑Systemen wird daraus ein Governance‑Thema: Welche Bereiche sollen grundsätzlich maschinell zugänglich sein, welche nicht? Und wie wird zwischen Bot‑Typen unterschieden (z. B. klassische Crawler, Previews, Fetch‑Systeme, agentische Abrufe)?

Typische Prüfbereiche:

- robots.txt & Robots-Meta-Tags: Erlauben/Verbieten‑Regeln, Noindex/Nofollow‑Signale

- Unbeabsichtigte Blockaden wichtiger Verzeichnisse (z. B. Blog, Ratgeber, Produkt‑ und Kategorieseiten)

- Blockierte Ressourcen (JS/CSS): Wenn für die Darstellung notwendige Dateien gesperrt sind, kann eine Seite für Maschinen inhaltlich „leer“ wirken

- Widersprüchliche Signale: robots.txt erlaubt den Zugriff, Meta‑Robots verbietet Indexierung (oder umgekehrt)

WAF/CDN/Rate‑Limiting: Wenn Sicherheitsmechanismen legitime Systeme treffen

Security‑Setups wie WAF (Web Application Firewall), CDN‑Regeln, IP‑Reputation‑Blocklisten und Rate‑Limiting schützen Websites vor Angriffen und Scraping. Gleichzeitig können sie legitime Crawler und Fetch‑Systeme beeinträchtigen.

Typische Prüfpunkte:

- 403/429‑Muster (Forbidden / Too Many Requests) in Server‑Logs bei Bot‑Traffic

- IP‑Reputation‑Blocklisten, die auch seriöse Systeme betreffen

- Challenge‑Mechanismen (z. B. interaktive Prüfungen), die automatisiertes Rendern oder Abrufen verhindern

- Unterscheidung automatischer vs. nutzerinitiierter Abrufe: Abrufe, die durch eine Nutzeraktion in einem KI‑Tool ausgelöst werden, können sich anders verhalten als kontinuierliches Crawling; beide Fälle sollten bewusst abgedeckt sein

Rendering: Sichtbarkeit ist nicht gleich HTML‑Download

Ein häufiger Stolperstein ist ein stark JavaScript‑getriebener Seitenaufbau. Wenn Kerninformationen erst clientseitig nachgeladen werden oder hinter Interaktionen liegen (Consent, Tabs, Accordions, Geo‑Switches), werden Inhalte oft schlechter erfasst – und noch schlechter extrahiert.

Bewährte Checks:

- Kerninhalte sind im initialen HTML vorhanden oder zuverlässig serverseitig renderbar (insbesondere Definitionen, Leistungsumfang, zentrale Fakten, Preis‑/Policy‑Informationen)

- Navigation und interne Links sind ohne komplexe JavaScript‑Abhängigkeiten zugänglich

- Consent‑Layer blockiert keine essenziellen Inhalte für Crawler oder Fetch‑Systeme

- Logfile‑Analyse bestätigt, dass relevante Systeme nicht systematisch in Sperren oder Fehlerzustände laufen

Layer 2: Retrieval – Strukturierte Daten und Entity‑Konsistenz als Anker

Retrieval‑Probleme entstehen selten durch fehlende Keywords, sondern durch fehlende Eindeutigkeit: Was ist Organisation, was ist Produkt, was ist Standort, was ist Angebot? Welche Aussagen gehören verbindlich wozu?

Strukturierte Daten: Stabilität statt „Rich‑Result‑Optimierung

Strukturierte Daten (z. B. Schema.org) sind im Agent‑Kontext vor allem eine Übersetzungsschicht: Sie liefern klare, maschinenlesbare Fakten und reduzieren Interpretationsspielraum.

Sinnvolle Schwerpunkte (abhängig vom Geschäftsmodell):

- Organisation/Unternehmen: Name, Logo, Kontaktwege, rechtliche Einheit, Referenzprofile

- Produkte/Angebote (Commerce): Preis, Verfügbarkeit, Varianten, eindeutige Identifikatoren (wo möglich)

- Inhalte: passende Content‑Typen (Artikel/Guide/FAQ), Autorenschaft und Aktualität dort, wo Vertrauen relevant ist

Knowledge-/Entity‑Konsistenz: Eine konsistente Realität

Viele Websites zeigen inkonsistente Realitäten: unterschiedliche Schreibweisen, abweichende Produktnamen, wechselnde Leistungsversprechen oder unklare Zuständigkeiten. Für KI‑Systeme wirkt das wie ein Zuordnungs‑ und Vertrauensproblem.

Typische Audit‑Fragen:

- Existiert eine zentrale Referenzseite („Entity Home“) mit konsistenten Kerndaten?

- Sind Betreiber‑, Kontakt‑ und Zuständigkeitsinformationen über Website, Profile und Dokumente konsistent?

- Sind Produktlinien, Variantenlogik und Benennungen über alle Seiten hinweg eindeutig?

- Gibt es wiederholte, verifizierbare Faktenpunkte, die als stabile „Anker“ dienen?

Feed- und Produktdatenqualität: Der Commerce‑Multiplikator

Im Commerce‑Kontext entscheidet Datenqualität oft stärker als Design. Agentische Systeme wählen und vergleichen entlang klarer Kriterien wie Preis, Lieferzeit, Verfügbarkeit, Rückgabe, Versandbedingungen und Bewertungen. Wenn diese Daten inkonsistent oder schwer auffindbar sind, sinkt die Chance, in Auswahl‑ oder Vergleichssituationen gut abzuschneiden.

Typische Schwachstellen:

- Abweichungen zwischen Website, Feed und strukturierten Daten (Preis/Verfügbarkeit)

- Unklare Varianten (Bundles, Größen, Farben, Kompatibilitäten)

- Lieferzeiten nur als vager Fließtext

- Retouren-/Servicebedingungen versteckt oder unnötig schwer verständlich

Layer 3: Consumability – Inhalte so gestalten, dass sie extrahierbar, vergleichbar und zitierfähig sind

Consumability bedeutet nicht „für KI schreiben“, sondern Inhalte so zu strukturieren, dass sie in Antwortsystemen zuverlässig genutzt werden können, ohne die menschliche Lesbarkeit zu beeinträchtigen.

Content‑Bausteine, die in KI‑Antworten funktionieren (und fachlich sauber sind)

Bewährt haben sich wiederkehrende Module, die auch für Marketing, Sales und Support nützlich sind:

- Definition‑Block („Was ist X?“): 2–4 präzise Sätze mit Begriff, Zweck und Abgrenzung

- Vergleichsblock (X vs. Y): Mini‑Tabelle oder Kriterienliste

- Kriterien‑Checkliste („Darauf kommt es an“): 6–10 operationalisierbare Kriterien

- FAQ aus realen Fragen: kurze Antworten, optional mit Vertiefung

- Prozess-/How‑to‑Abschnitt: Schrittfolge, typische Fehler und Missverständnisse

Zitierfähigkeit: überprüfbare Aussagen statt unverbindlicher Claims

Antwortsysteme bevorzugen Passagen, die als Beleg geeignet sind: definierte Begriffe, konkrete Kriterien, klare Einschränkungen und nachvollziehbare Aussagen. Superlative und vage Marketing‑Formulierungen sind schwer verwertbar, weil sie selten überprüfbare Information enthalten.

Typische Audit‑Fragen:

- Gibt es pro Abschnitt mindestens eine klare Aussage, die als Zitat funktionieren kann?

- Sind Zahlen/Behauptungen belegbar (interne Daten, Studien, Standards – je nach Kontext)?

- Sind Bedingungen (z. B. Preise, Laufzeiten, Einschränkungen, Voraussetzungen) eindeutig formuliert?

Layer 4: Actionability – Wenn KI‑Agents nicht nur lesen, sondern Schritte ausführen

Der entscheidende Zusatz gegenüber vielen klassischen Content‑/SEO‑Checks ist die Actionability‑Ebene. Hier geht es darum, ob eine Website als System so gebaut ist, dass Aktionen stabil ausführbar sind – unabhängig davon, ob bereits eine direkte Agent‑Integration existiert.

Typische Aktionen, die „agentenfest“ sein sollten:

- Termin buchen: eindeutige Zustände (Slot gewählt, Daten validiert, Bestätigung erhalten), klare Fehlermeldungen

- Anfrage stellen: robuste Formulare (klare Labels, serverseitige Validierung, verständliche Fehlertexte, Confirmation‑Pages)

- Konfigurieren/Angebot erstellen: eindeutige Regeln, nachvollziehbare Preislogik, klare Outputs

- Policies als Entscheidungsdaten: Versand, Rückgabe, Garantie, Supportzeiten, SLA – auffindbar, eindeutig, strukturiert

API-Verfügbarkeit (optional, strategisch relevant)

Nicht jedes Unternehmen braucht sofort eine öffentliche API. Ein Audit kann jedoch bewerten, ob intern bereits stabile Schnittstellen existieren oder ob kritische Prozesse nur über fragile UI‑Interaktionen möglich sind. Das ist häufig der Unterschied zwischen „später schnell anschlussfähig“ und „später mit erheblichem Neuaufbau“.

30/60/90‑Tage‑Plan: Von Quick Wins zur agentenfähigen Website

0–30 Tage: Stabilität und Basis‑Consumability

- robots/Access prüfen, Barrieren identifizieren

- Rendering‑Risiken reduzieren (Consent‑Gates, JS‑Abhängigkeiten)

- 5–10 wichtigste Seiten mit Definition/Vergleich/FAQ‑Blöcken ergänzen

- Trust‑Basics sichtbar und konsistent platzieren (Kontakt, Betreiber, Policies)

31–60 Tage: Retrieval verbessern (Struktur & Konsistenz)

- strukturierte Daten priorisiert ausrollen (Organisation + Kerninhalte + Produkte)

- Entity‑Konsistenz‑Sprint (Benennung, Kerndaten, Brand Hub)

- Feed-/Produktdaten konsolidieren (Preis/Verfügbarkeit/Varianten/Lieferlogik)

61–90 Tage: Actionability professionalisieren

- Buchung/Anfrage/Konfigurator robust machen (Fehlerlogik, Bestätigungen, Zustände)

- optional APIs definieren, dokumentieren und absichern

- Monitoring etablieren: Logs, strukturierte Daten, Datenqualität, Conversion‑Flows

Fazit

Agent Readiness ist eine Weiterentwicklung von SEO, Content und UX. Im Kern geht es um vier Ebenen: technische Zugänglichkeit, strukturelle Eindeutigkeit, inhaltliche Verwertbarkeit und stabile Handlungswege. Unternehmen, die diese Ebenen systematisch auditieren und priorisiert verbessern, schaffen eine Website‑Architektur, die in KI‑Antwortsystemen besser funktioniert und gleichzeitig klassische Ziele wie Vertrauen, Conversion und Datenqualität.

Wir unterstützen Ihr Unternehmen gern bei der Konzeption und Durchführung eines Agent Readiness Audits – von der technischen Zugänglichkeits‑ und Rendering‑Analyse über Entity‑/Daten‑Konsistenz und strukturierte Daten bis hin zu einer priorisierten Roadmap.